LEZIONI DEL CORSO DI FOTOGRAFIA DIGITALE.

NOZIONI DI BASE DI FOTOGRAFIA DIGITALE

FOTOGRAFIA AVANZATA

RITOCCO E STAMPA DA PC.

PROIEZIONE E CONDIVISIONE

APPROFONDIMENTI.

Cinefotografia

Cinefotografo

La fotografia

|

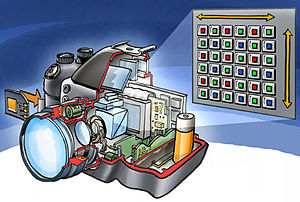

Una fotocamera digitale č una fotocamera che utilizza, al posto della pellicola fotosensibile, un sensore (CCD o CMOS) in grado

di catturare l'immagine e trasformarla in un segnale elettrico di tipo analogico. Gli impulsi elettrici vengono convertiti in

digitale da un convertitore A/D, nel caso del CCD in un chip di elaborazione esterno al sensore, nel caso del CMOS, direttamente

dal sensore, avendo implementato al suo interno anche il convertitore A/D, in entrambi i casi viene generato un flusso di dati digitali

atti ad essere immagazzinati in vari formati su supporti di memoria.

Le differenze

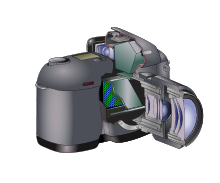

Fotocamera digitale di tipo reflex

Una fotocamera digitale č in quasi tutti gli aspetti esattamente identica ad una fotocamera convenzionale, se non per il fatto

che invece della pellicola fotografica in rullino usa un sensore elettronico che puň essere di diversi tipi. Questo acquisisce

l'immagine che successivamente viene convertita in una sequenza di informazioni digitali ed adeguatamente elaborate andranno a

formare un file (archivio).

In particolare per le macchine digitali vale come per quelle analogiche, e con lo stesso significato, la distinzione fra fotocamera

compatta e reflex. Vi sono comunque formati di fotocamera chiamati "bridge“ che hanno caratteristiche funzionali e di qualitŕ

immagine estremamente vicine, o a volte superiori alle fotocamere reflex digitali di fascia bassa, pur avendo un obiettivo fisso

come le compatte. All'inconveniente dell'ottica non intercambiabile alcuni produttori hanno ovviato introducendo in commercio

fotocamere "bridge" con ottiche zoom con ampia escursione focale (da 28 mm equiv. fino a 400 mm equiv.) benché la qualitŕ intrinseca

di queste ottiche non possa raggiungere quella delle ottiche di maggior prestigio dedicate agli usi professionali. La presenza di

un obiettivo fisso rende dunque sicuramente meno flessibile l’uso della fotocamera in contesti applicativi diversi, ma in positivo c’č da registrare il fatto che non esponendo l’interno della fotocamera (e quindi il sensore) all’aria durante il cambio di obiettivo, si evita l’accumulo di polvere sul sensore, fatto questo che porta ad avere un degrado della qualitŕ delle immagini riprese.

Le caratteristiche

Risoluzione

Secondo le regole attuali di mercato un parametro distintivo delle fotocamere č quello del numero di pixel. Per ottenere una buona fotografia risulta essere importante un'ottica di qualitŕ, un sensore che abbia un buon rapporto segnale/rumore, una buona gamma dinamica ed infine in funzione delle esigenze di stampa si sceglierŕ la risoluzione del sensore.

Una macchina fotografica non "ha" una "sua risoluzione". Si definisce tale la quantitŕ di pixel prodotti in uscita dal sensore. In fotografica invece spesso conta la profonditŕ di risoluzione, che č data dal numero di punti per pollice lineare, e che viene decisa in fase di stampa. Ovviamente fotocamere con sensori piů sofisticati, produrranno immagini con piů informazioni e che quindi potranno essere stampate con un numero di pixel per pollice maggiore, a paritŕ di dimensioni di stampa, delle immagini prodotte da un sensore meno efficiente.

Il sensore

Il sensore, analogo a quello utilizzato nelle videocamere portatili, puň essere CCD o C-MOS. Sempre e comunque si tratta di dispositivi fotosensibili costituiti da una matrice di fotodiodi in grado di trasformare un segnale luminoso in un segnale elettrico. Impiegando il CCD, la conversione del livello di luce in dato digitale avviene necessariamente all'esterno del sensore ad opera di un chip dedicato, nel CMOS la conversione avviene direttamente all'interno del chip/sensore, ogni fotodiodo ha il proprio amplificatore e convertitore A/D. In termini di qualitŕ, riferita a prodotti di consumo, una tecnologia non prevale sull'altra, solo su sistemi ai massimi livelli il CCD risulta qualitativamente ancora superiore, responsabili sono gli innumerevoli amplificatori e convertitori implementati nella matrice del chip CMOS insieme ai fotodiodi, i parametri dei quali possono discostarsi anche di pochissimo uno dall'altro, cosa che non succede nel CCD, avendo la possibilitŕ di convertire gli innumerevoli livelli del segnale luminoso tramite un chip dedicato, ottimizzato per questa funzione. Gli svantaggi del CCD rispetto al CMOS sono i maggiori costi di produzione e una maggiore lentezza di lavoro.

Nella fotocamera digitale, l'immagine viene messa a fuoco sul piano del sensore. I segnali cosě catturati vengono amplificati e convertiti in digitale. A questo punto i dati digitali sono in forma grezza (raw) e - cosě come sono - possono essere memorizzati su un file per una successiva elaborazione in studio, con altri apparecchi informatici. Successivamente il processore di immagine interno alla fotocamera trasforma questi dati, cioč calcola le componenti primarie mancanti su ogni pixel (RGB) e rende compatibili i dati di immagine con i normali sistemi di visualizzazione di immagini (generalmente nel formato JPEG o TIFF a seconda delle esigenze per le quali č destinata la fotocamera) ed infine immagazzina il file elaborato in una memoria a stato solido (ordinariamente dal punto di vista tecnologico si tratta di EEPRom di tipo Flash, mentre i formati con cui sono messe in commercio sono diversi (CF, XD, SD, MMC, Memory stick, ecc). Le schede contengono generalmente un rilevante numero di immagini, la quantitŕ dipende dalle dimensioni della singola immagine, dalla modalitŕ di registrazione e dalle dimensioni della memoria.

La risoluzione totale del sensore si misura in milioni di pixel totali. Un pixel č l'unitŕ di cattura dell'File: rappresenta cioč la piů piccola porzione dell'immagine che la fotocamera č in grado di catturare su una matrice ideale costruita sul sensore CCD.

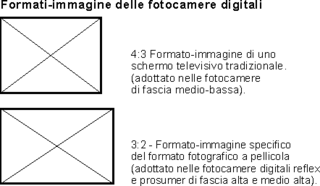

Le proporzioni delle immagini che si ottengono con gli attuali sensori (o attraverso elaborazioni del processore d'immagine interno alla fotocamera), sono indicate nella figura seguente:

Proporzioni delle immagini che si ottengono con gli attuali sensori

Moltiplicando il valore in pixel della risoluzione orizzontale per quello della risoluzione verticale si ottiene il numero totale di pixel che la fotocamera č in grado di distinguere in una immagine.

Le caratteristiche che attribuiscono qualitŕ ai sensori sono:

Elevato rapporto segnale rumore.

Questo fenomeno si evidenzia in modo particolare nelle riprese a bassa luminositŕ dove possono comparire degli artefatti di

immagine dovuti a segnali derivanti dal rumore elettrico di fondo degli elementi fotosensibili;

Elevata gamma dinamica.

Questo parametro indica l'ampiezza dell’intervallo di luminositŕ dal minimo registrabile al massimo registrabile prima che

l’elemento fotosensibile vada in saturazione.

Elevato numero di pixel.

L’elevata quantitŕ di elementi fotosensibili garantisce un elevato dettaglio di immagine, ma sorgono problemi di velocitŕ nel

trasferimento dei dati al processore d’immagine. Maggiore č la risoluzione, maggiore č il numero di pixel, maggiore sarŕ quindi

la quantitŕ di dati da trasferire e dunque, a paritŕ di velocitŕ di trasmissione, maggiore sarŕ il tempo necessario a

trasferire i dati al processore d’immagine e la successiva registrazione dell’immagine. Alcuni produttori hanno studiato

sensori con 4 bus dati di uscita dal sensore che trasmettono in parallelo i dati di immagine al processore della fotocamera.

Capacitŕ di non trattenere ombre sul sensore relative a riprese precedenti.

Questo problema si incontra prevalentemente nei sensori di tipo CMOS e richiede che i costruttori adottino strategie per ottenere

una sorta di cancellazione elettronica del sensore fra la ripresa di un'immagine e l'altra;

Capacitŕ del sensore di non produrre artefatti derivanti da interferenze (effetto moiré) fra i pixel in particolari

condizioni di ripresa;

Dimensione fisica del sensore a paritŕ di pixel (e quindi a paritŕ di risoluzione). Se la dimensione fisica del sensore č

elevata a paritŕ di numero di pixel questo comporta ovviamente una maggiore dimensione fisica dei pixel o dei photosite

(per un chiarimento sui termini photosite, pixel e elemento fotosensibile vedi il paragrafo "Numero di Pixel e qualitŕ

delle immagini" della voce correlata Fotografia digitale). Tale fatto rende maggiormente sensibili gli elementi dei photosite

(pixel) garantendo un miglior rapporto segnale/rumore. Ad esempio vi sono sensori da 6 MP (f.to 4:3) con dimensione 1/2,7” che

hanno una dimensione di 5,371 mm x 4,035 mm (diagonale = 6,721 mm), mentre altri sensori da 6 MP hanno dimensioni 1/1,8” e

dimensione di 7,176 mm x 5,319 mm (diagonale = 8,933 mm). In termini di rumore e di sensibilitŕ la qualitŕ del sensore č

normalmente maggiore nel sensore piů grande.

I sensori di alcune fotocamere REFLEX professionali hanno il sensore di formato 3:2 ed un rapporto 1:1 con il fotogramma della

pellicola (Full-Frame), una dimensione quindi di 24x36 mm. Con queste dimensioni – oltre ad avere un basso rumore, risulta

possibile garantire che l'angolo di campo delle ottiche non sia alterato (rapporto 1:1 fra angolo di campo della fotocamera con

sensore e quella a pellicola).

La qualitŕ dell'immagine tuttavia č importante relativamente alla modalitŕ di fruizione: se le immagini si utilizzano a

video non ha molta rilevanza la risoluzione, ma se si intendono realizzare stampe di grande formato allora la risoluzione diventa

un parametro da tenere presente. Tanto piů si vorrŕ effettuare una stampa grande di una foto digitale, tanto piů la fotocamera

dovrŕ produrre immagini ad una risoluzione elevata. Ecco alcuni esempi:

- Una foto in formato standard da 14 cm di larghezza necessita di 1.2-2 megapixel di risoluzione per risultare

pari ad un prodotto di una macchina fotografica tradizionale;

- Per stampare su di un foglio A4 sono necessari dai 2 ai 3 megapixel;

- Per realizzare un poster da 60–70 cm sono consigliabili risoluzioni non interpolate di piů di 5 megapixel;

Interpolazione

Altro parametro a cui andrebbe rivolta una certa importanza da chi della fotografia vuol fare qualcosa piů di un hobby č la

questione dell'interpolazione. Tale tecnica matematica viene infatti utilizzata in due modalitŕ diverse a volte contemporaneamente

sulla stessa fotocamera:

nelle fotocamere a bassa risoluzione si utilizza per generare dei pixel ulteriori a quelli catturati dal sensore

generandone il valore di cromia per portare ad esempio una risoluzione di una fotocamera da 3 Mpixel a 4 Mpixel.

Il procedimento in realtŕ non aggiunge informazioni vere all’immagine, ma rende meno evidente la quadrettatura dovuta al pixel se si volesse ingrandire l’immagine oltre il consentito. Č un procedimento usato anche negli scanner attraverso un'elaborazione software.

In tutte le fotocamere che adottano un sensore con Color Filter Array si usa l’interpolazione per generare in ogni pixel le due componenti cromatiche mancanti, in questo caso si tratta propriamente di interpolazione cromatica.

In merito a quest'ultima modalitŕ infatti va detto che il sensore - composto da milioni di elementi fotosensibili - solo nel suo complesso cattura informazioni riguardanti le tre componenti RGB (Red-Green-Blue) (Rosso-Verde Blu) che compongono la luce della scena focalizzata sulla sua superficie. Quasi tutti i sensori, anche se con modalitŕ diverse, hanno i photosite (che normalmente hanno un solo photodetector per photosite) che catturano una sola componente cromatica della luce. Sulla superficie del sensore infatti č collocato un filtro a mosaico denominato Color Filter Array (CFA), il piů diffuso č di tipo Bayer che a sua volta puň presentare diverse varianti sul numero dei colori che vengono filtrati (3 o 4) e sulla disposizione dei colori sul mosaico. Il piů comune č quello denominato GRGB che ha il 50% dei photodetector che catturano il Verde (G), il 25% che catturano il Rosso (R) ed il rimanente 25 % che catturano il Blu (B). Per ottenere una adeguata fedeltŕ cromatica dell’intera immagine, ogni pixel registrato in un file grafico a colori (fa eccezione il file di tipo Raw) deve contenere le informazioni cromatiche di tutte e tre le componenti RGB della luce incidente su ogni pixel. Questo perché la riproduzione delle immagini luminose avviene per mescolanza additiva delle tre componenti primarie della luce. Poiché ogni photodetector ne cattura solo una di queste (R, G o B), non puň fornire tutti i dati per la formazione del pixel, cosě le altre due informazioni cromatiche vengono calcolate dal processore d’immagine attraverso un procedimento matematico (algoritmo di demosaicizzazione – demosaicing). Solo cosě il pixel, inteso come raggruppamento dei dati cromatici della piů piccola porzione che forma l'immagine, puň concorrere ad una rappresentazione fedele dei colori dell'immagine.

Diversamente avviene per. es. in alcuni scanner ed in alcune fotocamere dove:

l’interpolazione serve ad aumentare in modo artificiale il numero di pixel senza che vi sia riferimento a nessun oggetto reale;

e nei quali la risoluzione vera č quella ottica, non quella ottenibile via software,

nelle fotocamere digitali il processo interpolazione cromatica comune a tutte quelle dotate di CFA consiste nel calcolare il valore delle due componenti cromatiche mancanti su ogni pixel a partire normalmente dai valori contigui al pixel in questione aventi la stessa componente cromatica che si intende calcolare. L’approssimazione – peraltro abbastanza precisa - č quindi sul dettaglio cromatico dell’immagine e si consideri che comunque una delle tre componenti č realmente rilevata da ogni pixel. Al momento (aprile 2009) in commercio risulta esservi un solo sensore, prodotto da Foveon, che cattura le tre componenti RGB su un unico photosite. Questo viene montato su alcuni modelli di fotocamere, ma la sua diffusione č piů ridotta rispetto ai sensori dotati di C.F.A. Una precisa distinzione fra pixel, photosite e elemento unitario fotosensibile=photodetector) si trova nel paragrafo Numero di Pixel e qualitŕ delle immagini della voce correlata fotografia digitale. Invece un approfondimento sulle diverse modalitŕ di formazione delle immagini nelle fotocamere digitali, sulla formazione dei file delle immagini per interpolazione in base alle esigenze di profonditŕ colore e sulla elaborazione dei file Raw, si trova alla voce Raw (fotografia)

|

Sopra: esempio di fotocamera digitale.

Un poco di storia.

Il primo prototipo si ha nel 1975 e venne ideato da Steven Sasson, un ingegnere della Kodak, sfruttando un sensore CCD; mentre la

presentazione ufficiale di una macchina digitale si ha nel 1981 con la Sony Mavica, la quale registra le immagini su floppy-disk;

mentre la prima macchina completamente digitale si ha nel 1988 con la Fuji DS-1P, che registra le immagini su flash card

removibili e usa un sensore CCD.

Sopra: schema di una fotocamera digitale.

Sotto: fotocamera reflex.

|

Risoluzioni e Megapixel

Mella tabella sotto, sono riportate alcune delle risoluzioni piů diffuse, con alcune delle fotocamere che li utilizzano:

Larghezza

(pixel)

320

570

640

832

1.024

1.280

1.280

1.600

2.012

2.048

2.272

2.464

2.640

2.560

2.816

3.008

3.072

3.072

3.456

3.264

3.504

3.520

3.648

3.872

3.888

4.064

4.000

4.256

4.272

4.288

4.368

4.672

4.928

4.992

5.184

5.616

6.048

7.360

7.212

7.264

8.176

8.984

|

Altezza

(pixel)

240

490

480

608

768

960

1.024

1.200

1.324

1.536

1.704

1.648

1.760

1.920

2.112

2.000

2.048

2.304

2.304

2.448

2.336

2.344

2.736

2.592

2.592

2.704

3.000

2.832

2.848

2.848

2.912

3.104

3.264

3.328

3.456

3.744

4.032

4.912

5.142

5.440

6.132

6.732

|

Aspect

ratio

4:3

4:3

4:3

4:3

4:3

5:4

4:3

3:2

4:3

4:3

3:2

3:2

4:3

4:3

3:2

3:2

4:3

3:2

4:3

3:2

3:2

4:3

3:2

3:2

3:2

4:3

3:2

3:2

3:2

3:2

3:2

3:2

3:2

3:2

3:2

3:2

4:3

4:3

4:3

4:3

4:3

|

Dimensioni

immagine (pixel)

76.800

279.300

307.200

505.856

786.432

1.228.800

1.310.720

1.920.000

2.663.888

3.145.728

3.871.488

4.060.672

4.646.400

4.915.200

5.947.392

6.016.000

6.291.456

7.077.888

7.962.624

7.990.272

8.185.344

8.250.880

9.980.928

10.036.224

10,077,696

10.989.056

12.000.000

12.052.992

12.166.656

12.212.224

12.719.616

14.501.888

16.084.992

16.613.376

19.200.000

21.026.304

24.385.536

36.152.320

39.031.344

39.516.160

50.135.232

60.480.288

|

Megapixel

0,08

0,28

0,3

0,5

0,8

1,3

1,3

2

2,74

3

4

4,1

4,7

5

6

6

6,3

7

8

8

8,2

8,25

10

10

10,1

11

12

12,1

12,2

12,2

12,7

14,5

16,3

16,6

18

21

24,4

36,2

39

40

50,1

60,5

|

Fotocamere di esempio

Prototipo di fotocamera digitale di Steven Sasson (1975)

Sony Mavica su floppy disk (1981)

Apple QuickTake 100 (1994)

Canon Powershot 600 (1996)

Olympus D-300L (1996)

Fujifilm DS-300 (1997)

Fujifilm MX-700 / Leica Digilux (1998), Fujifilm MX-1700 (1999) / Leica Digilux Zoom (2000)

Nikon Coolpix 950

Nikon D1

Canon PowerShot A75, Nikon Coolpix 995 Epson 3100z

Olympus Stylus 410

Canon 1D

Sigma SD14, Sigma DP1 (4.646.400 photosite, 14 Mega photodetector, 3 photodetector per photosite, ogni photosite

fornisce i 3 dati RGB che costituiscono un pixel; sensore Foveon X3)

Olympus E-1, Sony Cyber-shot DSC-F707, Canon PowerShot A460

Olympus Stylus 600 Digital

Nikon D40, D50, D70, D70s, Pentax K100D

Canon 300D, Canon 10D

Olympus FE-210

Canon 350D

Olympus E-500, Olympus SP-350, Canon PowerShot A720 IS

Canon 30D, Canon 1D II, Canon 1D II N

Canon 20D

Olympus E-410, Olympus E-510, Panasonic FZ50

Nikon D40x, Nikon D60, Nikon D200, Nikon D80, Pentax K10D, Pentax K200D, Sony Alpha A100

Canon 400D, Canon 40D

Canon 1Ds

Canon Powershot G9, Fujifilm FinePix F100fd, Canon Digital IXUS 960 IS

Nikon D3, Nikon D700

Canon 450D

Nikon D2Xs/D2X, Nikon D300, Nikon D90

Canon 5D

Pentax K20D

Pentax K-5 II

Canon 1Ds II, Nikon D4

Canon EOS 7D, Canon EOS 550D, Canon EOS 60D

Canon 1Ds III, Canon 5D Mark II

Sony Alpha 900, Nikon D3X

Nikon D800, Nikon D800E

Hasselblad H3D-39

Pentax 645D

Hasselblad H3D-50

Phase One P65+ Hasselblad H4D-60

|

|

Dimensioni fisiche del sensore

Il sensore ottico digitale ha determinate misure, che non sono proporzionali con la risoluzione del sensore, anche se determinate

dimensioni del sensore ne limitano la risoluzione massima.

I sensori possono sia avere una dimensione fisica paragonabile al sistema analogico a pellicola, denominato Advanced Photo

System, con i corrispettivi digitali APS-C e APS-H, ma esistono anche altri formati come il 35mm e i formati compatti, come

i 1/2,5", 1/1,8", 1/1,7" e 1/1,6", dove il formato 1/2,5" č quello di dimensioni minori, mentre tra i formati maggiori esiste

il "Medium format".

Le memorie

Una volta convertito il segnale in arrivo dal sensore (CCD o C-MOS) ed elaborato dal processore d’immagine, la fotocamera

registra un file contenente l'immagine scattata su una memoria gestibile dall'utente. Alcune fotocamere economiche dispongono di

una memoria interna di salvataggio immagini, alla quale normalmente č sempre possibile aggiungerne una esterna.

Dal punto di vista tecnologico - quel punto di vista che specificamente si occupa di conoscere la modalitŕ di immagazzinamento dei

dati elementari su un supporto di memoria - va detto che il tipo di memorie prevalentemente usato č di tipo EEPROM flash

(Electrically Erasable and Programmable Read Only Memory - flash). La tecnologia "flash" consente di accedere alle celle di

memoria per blocchi, o aree, rendendo piů rapido il processo di lettura-scrittura-cancellazione). Per questo occorre distinguere

fra la tecnologia costruttiva degli elementi di memorizzazione (per tutte le schede di memoria si tratta, come visto, di

EEPROM-flash) e i formati con cui vengono prodotte le schede di memoria. I formati di scheda di memoria realizzati con celle a

semiconduttore utilizzati dalle case costruttrici di fotocamere digitali, sono principalmente:

Compactflash

- Compactflash Extreme III

- Compactflash Ultra

-Compactflash Ultra II

-Compactflash Ultra Speed

Memory Stick

MultiMedia (MMC)

SD (secure digital)

mini-SD

TransFlash (o micro-SD)

SmartMedia

XD - xD tipo M - xD tipo H (foto panoramiche per le Olympus e Fujifilm)

Vi sono poi schede di memoria come la seguente:

Microdrive

le quali non sono riconducibili a celle a semiconduttore, bensě a supporti magnetici dello stesso tipo degli hard disk

dei PC, ma che per contro adottano lo stesso formato delle memorie a semiconduttore. Nel caso delle Microdrive il formato č

quello delle C.F. CompactFlash

Invece altri formati, inoltre, come il:

miniCD-ROM

fanno riferimento ad un supporto ottico di memorizzazione (mini-CD). Tecnica di memorizzazione oggi sostanzialmente abbandonata,

ma che prevedeva nelle fotocamere l'incorporazione di un masterizzatore per mini-CD.

Un elenco completo puň essere trovato alla voce Scheda di memoria.

I formati di salvataggio delle immagini

I formati utilizzati nelle fotocamere digitali per il salvataggio delle immagini sono:

- JPG: il piů usato nelle fotocamere economiche. Permette di salvare grandi immagini in file di piccole dimensioni,

pur perdendo dettagli all'occhio impercettibili ma che rischiano di diventare evidenti in caso sia necessario effettuare

successive manipolazioni di fotoritocco all'immagine salvata. Si tratta di un formato compresso di tipo LOSSY, ovvero con

perdita di dati.

- TIFF: formato in grado di salvare immagini senza perdita di informazioni. Il salvataggio puň essere non compresso o

compresso di tipo LOSSLESS. Si puň osservare come questo formato, se si sfrutta la compressione, produca immagini identiche

alle BMP ma della dimensione di una BMP compressa con ZIP.

- BMP: formato di salvataggio poco utilizzato, per via del fatto che il file č di dimensioni piuttosto elevate. Le immagini

possono essere salvate con una profonditŕ di colore di 16, 24 e 32 bit senza nessun tipo di compressione.

- Raw: formato utilizzato dai professionisti e dai fotoamatori evoluti. Una fotocamera settata per salvare il formato Raw

di una istantanea salverŕ nella memoria utente esattamente l'output digitalizzato ottenuto dal sensore della fotocamera

stessa, senza alcun tipo di modifica se non la conversione Analogico/Digitale (conversione A/D). I dati dovranno essere

quindi ricomposti su un computer secondo specifici protocolli della casa madre definiti per lo specifico sensore utilizzato.

Solo successivamente le immagini cosě ricomposte ed eventualmente regolate in luminositŕ ed altro, saranno convertibili ed

utilizzabili in qualsiasi formato conosciuto.

Torna alla HomeBase

|

|

Vantaggi dei file Raw

Il principale vantaggio del Raw va ricercato nella modalitŕ di registrazione del file e nelle possibilitŕ di elaborazione che

esso offre successivamente allo scatto. Un file Raw durante la conversione da analogico a digitale č normalmente campionato

almeno a 12 bit per canale (R,G o B). Ognuno dei canali cromatici a questo livello della elaborazione č ancora incompleto avendo

solo i segnali raccolti dai photodetectors e non anche quelli generati per interpolazione. Alcune fotocamere di alto livello

producono file Raw con campionamento a 16 bpp (bpp=bit-per-pixel o, meglio, bit-per-photodetector) e, come si č visto, questa č

una sola delle tre componenti del pixel. I software di elaborazione dei file RAW hanno la possibilitŕ quindi di produrre file

grafici RGB a 48 bpp (qui č perfettamente corretto ritenere b.p.p. come bit-per-pixel, perché, quando il file grafico č elaborato,

ogni pixel contiene tutte e tre le componenti RGB necessarie per definire ogni elemento del pixel). Per questa elevatissima

profonditŕ colore il file si presta ad elaborazioni anche abbastanza spinte senza che la qualitŕ e dettaglio di immagine degradino

troppo. Si consideri che normalmente la generazione del file TIFF o del file JPG avviene a profonditŕ colore di 24 bpp (che

equivale ad 8 bpp per ognuno dei canali RGB) quindi per la stampa č normalmente richiesto un dettaglio cromatico (=profonditŕ

colore) molto minore. Tale caratteristica tecnica dei file Raw permette una lavorazione in studio delle immagini senza alterarne

la qualitŕ. Ma non solo. L'utilizzo dei file RAW consente addirittura di apportare in un secondo momento con elaborazioni in

studio dei miglioramenti significativi alla qualitŕ dell'immagine scattata, potendo per esempio aggiustare il bilanciamento del

bianco, ridurre eventuali aberrazioni cromatiche degli obiettivi, ottimizzare l'esposizione con un campo di variazione abbastanza

elevato, applicare filtri antirumore, ecc.

Č invece secondaria e fuorviante la ragione che vede nel file Raw la possibilitŕ di compiere scatti in rapida successione

(chiamata anche "funzione di scatto a raffica" delle fotocamere), anche perché tale funzione delle fotocamere viene svolta molto

piů rapidamente con altri formati come il JPG. Usando questa funzione infatti la fotocamera ha necessitŕ di tenere in memoria i

dati delle immagini scattate nella raffica. Quindi, per questo, occorre integrare nella fotocamera una sorta di memoria di

servizio (buffer) dove parcheggiare le immagini prima della loro scrittura nella scheda di memoria. Poiché le immagini JPG,

anche se composte in alta qualitŕ, hanno una dimensione di circa 1/4 della stessa immagine in Raw, lo svolgimento di tale funzione

non comporta l'impiego di una grande quantitŕ di memoria interna. Quindi tale funzione in JPG č molto frequente trovarla nelle

fotocamere anche di fascia medio-bassa. A questo proposito si consideri che il tempo di registrazione dell'immagine nella scheda

di memoria č normalmente molto superiore a quello che impiega il processore d'immagine ad elaborare i dati grezzi in arrivo del

sensore per formare l'immagine JPG. Dunque, complessivamente, il tempo impiegato dalla fotocamera per svolgere la funzione di

scatto a raffica č comunque minore in JPG rispetto al formato Raw.

Nonostante queste caratteristiche della funzione che permette scatti in rapida successione, vi sono fotocamere professionali,

semi-pro, e compatte-prosumer di fascia alta, che presentano questa possibilitŕ di registrare immagini in Raw con scatto a

raffica. Tale diffusione č stata agevolata dal progressivo calo di costo delle celle di memoria che ha reso economicamente

vantaggioso aumentare questa memoria buffer interna alle fotocamere. Questo fatto ha reso disponibile la funzione di scatto in

rapida successione anche in fotocamere digitali non professionali che comunque possiedono prestazioni tali da far valutare

positivamente tale funzione. Va detto tuttavia che nonostante l'uso dello scatto a raffica non sia cosě frequente come lo

scatto singolo, tale funzione č apprezzata dai professionisti e dai fotoamatori evoluti.

Inoltre tale funzione di scatto a raffica in Raw č conseguenza anche del miglioramento dell'elettronica delle fotocamere che

ha reso piů veloce le procedure di elaborazione e di trasferimento delle immagini. Nell'utilizzo dei file Raw occorre tenere

presente che:

la memorizzazione di un file Raw ha una dimensione elevata dunque richiede piů tempo per la sua registrazione nella scheda

di memoria. Molto piů rapida č la memorizzazione di un file JPG, registrato anche in alta qualiŕ (dimensioni elevate del file).

Questo comporta l'effetto finale secondo cui il tempo per registrare un file JPG č molto piů basso rispetto a quello necessario

per registrare un file Raw. E questo č valido anche se si considera che il processore d'immagine interno alla fotocamera spende

un po' piů di tempo per la formazione del file JPG a partire dai dati grezzi d'immagine.

Nel caso invece dello scatto a raffica (da tre in poi) i dati Raw delle immagini scattate in rapida successione

vengono trattenuti in una memoria interna "di servizio" della fotocamera (buffer). Per svolgere questa funzione occorre

perň dotare la fotocamera di una sufficiente quantitŕ di memoria interna che dovrŕ essere tanto maggiore quanto maggiore č

la dimensione del file Raw e quanto maggiore č il numero degli scatti della raffica.

Fotocamere usate come videocamere

AVI, MOV, RealMedia: questi formati di file vengono utilizzati dalla maggior parte delle fotocamere in commercio per realizzare

piccole sequenze video. La durata dei video cosě prodotti č solitamente limitata (difficilmente superiore ad alcuni minuti se si

impiega la limitata memoria interna), a causa degli algoritimi di compressione e dei codec video impiegati, semplici e quindi

veloci (viste le ridotte capacitŕ di calcolo dell'hardware presente), ma non particolarmente performanti in termini di

compressione. Tale caratteristica č di facile realizzazione data la natura dell'architettura delle fotocamere digitali, ma non

si deve pensare che tali filmati possano essere equiparabili a quelli prodotti da videocamere digitali o analogiche: le modalitŕ

di otturazione, il buffer utilizzato dal CCD, la natura del software della fotocamera e le tipologie di ottiche impiegate nelle

prime generalmente non consentono di realizzare filmati comparabili con quelli prodotti dalle seconde. Le stesse risoluzioni dei

filmati, solitamente derivati dalle risoluzioni VGA dei computer o da loro frazioni (640x480, 320x200, ecc.), rispetto a quelle

delle videocamere (derivate dalle risoluzioni televisive), e un audio spesso con frequenze di campionamento molto ridotte,

indicano un impiego pensato piů per l'informatica e la pubblicazione via web che la produzione audiovisiva.

Tale limitazioni, seppur ancora molto diffuse, sono perň in fase di riduzione: in alcuni dispositivi č stato predisposto un

sistema di codifica tale per cui i filmati vengono direttamente compressi con algoritmi piů efficienti (come il DivX), in grado

quindi di rendere il sistema adatto a registrare filmati di maggiore durata. L'aumento delle dimensioni delle memorie esterne

allo stesso tempo garantisce maggiore spazio a disposizione per i file video, indipendentemente che questi usino un algoritmo

efficiente o meno (ovviamente nel primo caso il guadagno in tempo di registrazione č ancora maggiore). Recentemente si stanno

diffondendo fotocamere di fascia alta in grado di riprendere in full HD nel codec H.264, con un bit/rate di 46Mb/s massima. I

limiti sono ancora nella durata della registrazione (con simili bitrate anche le memorie di dimensioni maggiori sono

insufficienti per filmati di lunga durata) e nell'ergonomia dell'impugnatura, non ideale per la stabilitŕ di ripresa.

Prova del fatto che le fotocamere siano diventate quasi intercambiabili con le videocamere č il fatto che si cominciano a

vedere le prime serie TV riprese in digitale con fotocamere, come č stato per esempio per l'ultimo episodio della sesta stagione

di Dr. House - Medical Division, che č stato girato con una Canon 5D Mark II.

|

|

|